注*:文章约3,600字,全文阅读完大约需要 7-12 分钟

本文目录如下

1 传感器: 机器人的重要能力基座

1.1 机器人任务闭环: 感知-决策-执行

1.2 模型能力是当前具身智能发展的核心瓶颈

1.3 从看见到感知,视/力觉传感器构建立体感知

1.4 机器人技术路线未收敛,传感器具备高确定性增量

2 感知层: 视觉为能力底座,多技术路线并行

2.1 视觉感知: 机器人信息输入核心通道

2.2 本体厂视觉方案选择逻辑

2.3 视觉传感器主要厂商梳理

2.4 视觉传感器市场空间预测

1 传感器:机器人的重要能力基座

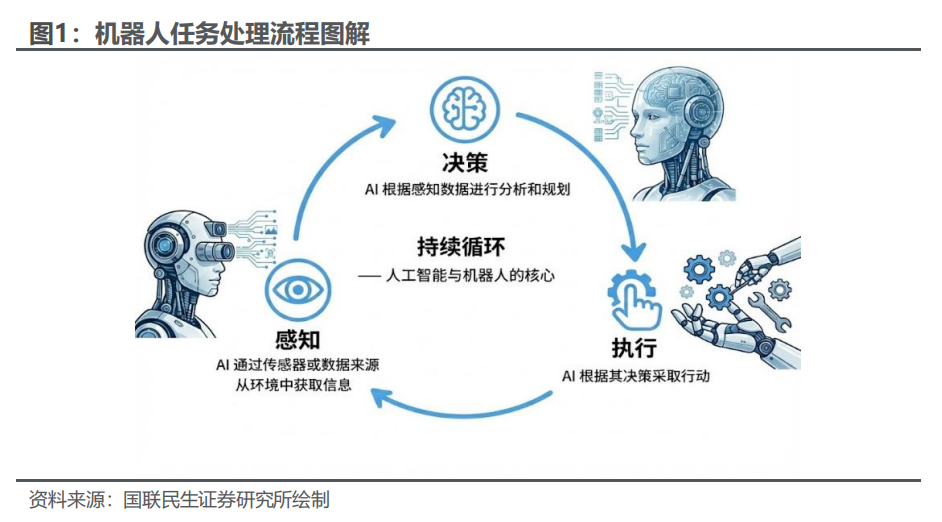

1.1 机器人任务闭环:感知-决策-执行

机器人完成复杂任务通常遵循“感知—决策—执行”的闭环。感知模块负责采集环境与自身状态信息,决策模块基于这些数据进行任务理解、状态估计和动作规划,执行模块则将控制指令转化为物理动作,并通过传感器实时反馈,持续调整系统行为。这一流程是机器人在非结构化环境中稳定运行的基础。

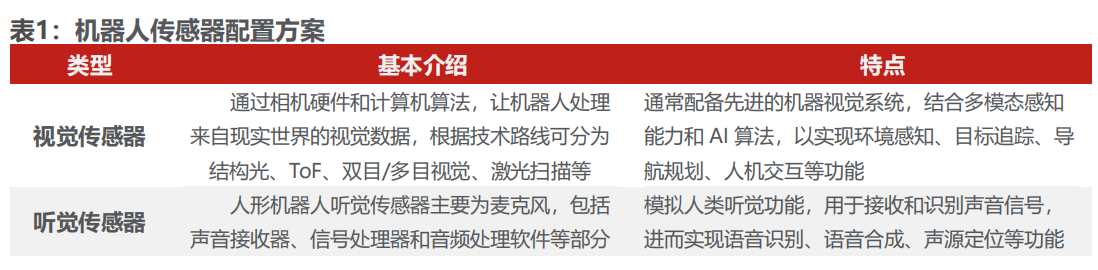

在感知环节,传感器负责将物理信号转化为可供算法处理的数据。视觉传感器主要负责环境感知与空间理解,而IMU 与关节编码器等本体传感器提供高频的姿态与运动状态信息。由于单一传感器在复杂动态环境中难以维持稳定性,多模态传感器融合方案逐渐成为主流选择。

决策环节依赖机器人感知层输入的数据进行状态推理与动作规划。在机器人任务执行过程中,决策系统不仅依赖视觉进行目标识别和路径规划,还需结合惯性与力觉信息,实时评估动态平衡、接触状态及潜在风险,从而生成符合安全和稳定要求的控制指令。

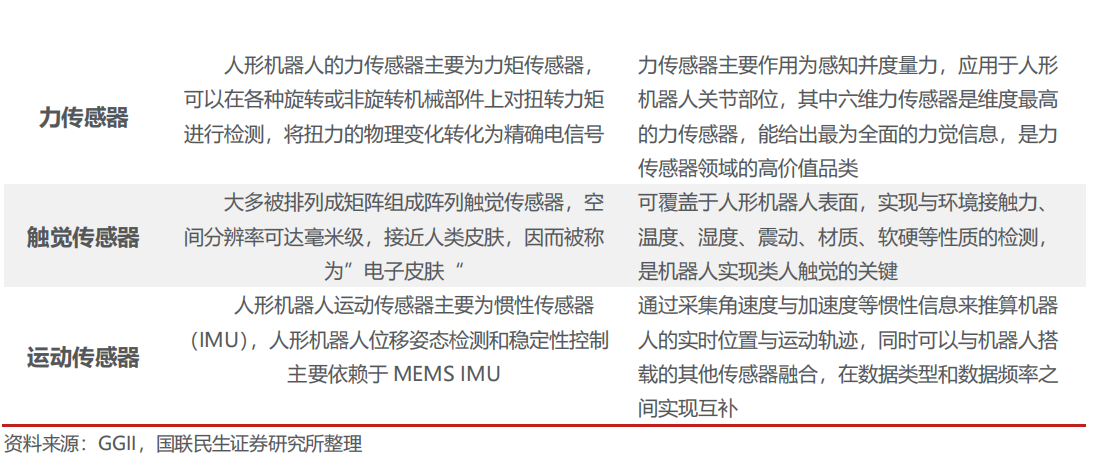

执行环节是机器人与物理世界交互的关键阶段。在面对平衡控制、复杂步态与精细操作等高动态任务时, 仅依赖开环控制或单一感知信息已难以满足稳定性与安全性要求。力/力矩传感器、触觉传感器与 IMU 等提供持续的接触状态、受力变化与姿态反馈,构成高频闭环控制基础,使机器人能够在不确定环境中实现自主精细操作。

1.2 模型能力是当前具身智能发展的核心瓶颈

在机器人的“感知—决策—执行”闭环体系中,机器人综合能力的演进呈现出显著的螺旋式上升特征。模型作为机器人的“大脑”,是决定系统能力上限的核心主导变量。模型的演进路径直接定义了对底层数据的需求模态,进而决定了传感器的选型与配置: 当模型向精细化操作演进时,力/触觉传感器成为刚需;若侧重空间导航,则视觉与激光雷达数据成为核心。这种“模型定义需求,传感器匹配模型”的逻辑,构成了当前产业技术发展的基本生态。传感器的精度与采样频率的提升能显著优化模型的推理效果,而执行器性能的增强(如高动态响应、高精度操作)则反向对传感器的实时反馈能力提出了更高要求。

从产业成熟度来看, 当前具身智能领域存在明显的“木桶效应”,模型能力仍是机器人进化的短板。传感器受益于汽车智能化产业链的多年积淀,执行器则在工业机器人领域拥有深厚的制造基础,二者均已进入相对成熟的放量期,相比之下,模型能力是目前制约机器人向通用化迈进的核心短板。尽管早期模型在复杂环境下的泛化准确度仍有待提升,但随着多模态大模型与具身数据的深度融合,模型正加速从“感知智能”向“认知智能”进化。未来,随着模型这一核心短板的补齐,机器人产业将迎来向算法驱动转型的加速发展期。

1.3 从看见到感知,视/力觉传感器构建立体感知

从能力维度看,机器人本质上是一个运行在三维物理世界中的复杂系统,其对传感器的依赖程度显著高于以二维运动为主的自动驾驶系统。 自动驾驶系统只需控制汽车在二维平面内完成移动与避障, 而机器人不仅需要在三维空间中完成运动,还必须与物体发生真实接触,执行抓取、操作、装配等复杂任务。这一能力差异决定了机器人在感知层面必须同时具备“看见世界”和“感知世界”的能力。

视觉传感器作为机器人之“眼”,负责将外界环境数据输入到机器人系统,是机器人“看到世界”的基础。通过多目视觉、深度感知等技术,机器人可以识别环境结构、目标位置,为路径规划与动作生成提供初步信息。但仅依赖视觉感知,难以覆盖真实物理交互中的不确定性,尤其在抓取物体时,识别物体并控制力度难度较大。 因此,在机器人由感知到执行的过程中,力/力矩与触觉传感器成为不可替代的能力补充。

力觉与触觉传感器使机器人能够直接感知接触状态、受力变化与物体属性,实现对真实物理世界的“内在感知”,从而支撑柔顺控制、精细操作与安全交互。整体来看,视觉、力觉与触觉共同构成了机器人从看到世界到感知世界的能力基座,其配置水平直接决定了机器人从“能看、能走”向“能抓、能用、能协作”的能力上限,因此也是机器人传感器中最为重要的种类。

1.4 机器人技术路线未收敛 ,传感器具备高确定性增量

从当前产业阶段看,机器人在本体形态、感知方案与控制架构等方面仍处于多路线并行探索阶段,技术路径尚未收敛。但与本体结构或算法范式存在明显分化不同,传感器作为机器人感知与控制的基础能力单元,在不同机器人形态中均具备高度共通的工程需求。

无论机器人采用何种本体结构或控制架构,其稳定运行均依赖对环境状态、自身状态以及物理交互状态的持续感知。这一需求使得传感器尤其是视觉/力觉传感器具备较强跨平台、跨场景的技术通用性,成为不同机器人形态中复用程度较高的底层硬件模块之一。

当前人形机器人成本结构中 ASP 较高且占据核心成本地位的传感器主要集中在力觉感知与灵巧操作两大核心环节。其高价值量主要由技术壁垒与功能决定性双重因素驱动:六维力传感器作为实现柔顺控制与精密装配的关键,需实时解算三维空间内的力与力矩,技术门槛高企,成本较高;关节编码器作为运动闭环控制的核心反馈元件,因机器人全身高自由度的需求而总量较大。总体来看,目前机器人硬件成本的高地明确指向那些模拟人类精细触觉与本体感觉、且尚未实现大规模工业化降本的高端力学与位置传感器。

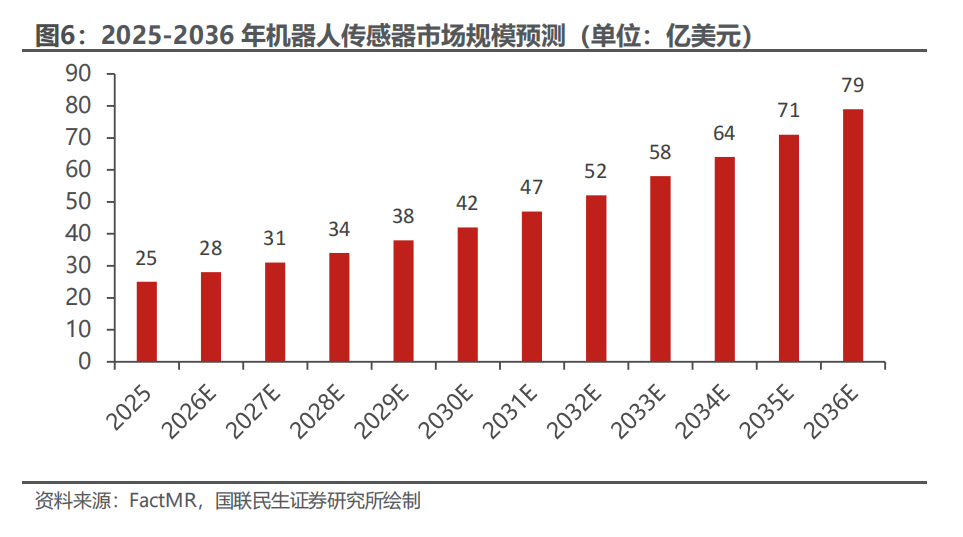

随着机器人从实验验证逐步走向规模化应用,对稳定性、安全性的要求持续抬升,传感器在整机中的配置重要性与价值占比有望同步提升。整体来看,传感器是少数不依赖于单一路线胜出的硬件环节,在多种机器人形态与应用场景中均具备长期、确定性的增长基础。根据FactMR 预测,2026 年全球机器人传感器市场预计将达 28 亿美元, 到 2036 年将增长至约 79 亿美元, 2026 年~2036 年 CAGR约 10.9%。

2 感知层:视觉为能力底座,多技术路线并行

2.1 视觉感知:机器人信息输入核心通道

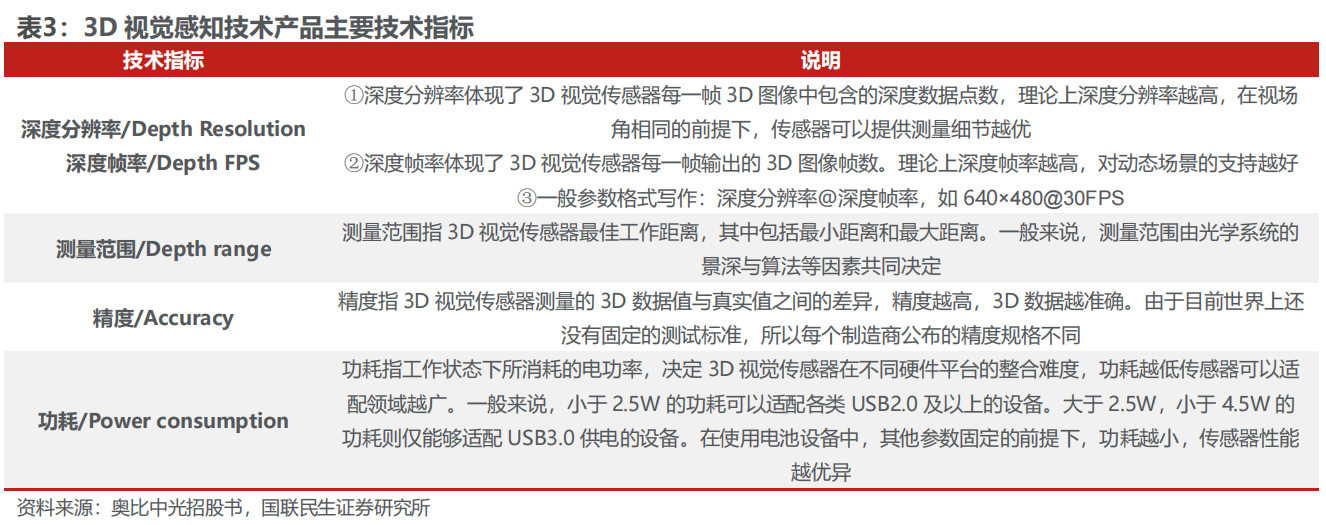

人类获取外界信息大部分依赖视觉,机器人需要在非结构化场景复制人的感知与交互,因此视觉传感器成为信息输入的主要通道。目前视觉技术按照成像维度的不同, 可以划分为 2D 和 3D 两大类别。 伴随技术发展, 2D 视觉技术的分辨率从最初的数十万像素提升至现今的数亿像素,图像的色彩还原变得更加真实,图像质量也得到了显著提升。尽管如此, 2D 成像技术使用到的传统 RGB 相机, 仅能捕捉到物体表面的纹理信息,没有物体到相机的距离信息,无法提供对于精确的识别、追踪等功能所需的空间形态、几何尺寸和位置姿态信息等。3D 视觉相对于 2D应用场景更加复杂、精度更高、视觉信息获取量更加丰富。

3D 视觉成像技术可分为光学和非光学成像方法。目前行业内应用较为广泛的为光学方法,其中最常用的方法为包括:飞行时间(ToF)法(包括 dToF、iToF)、双目视觉法、结构光法以及 Lidar(主要用于汽车自动驾驶)。 目前市场上常见的3D 视觉产品为激光雷达(LiDAR)及深度相机(又称 3D 相机)。

随着人形机器人与外界复杂环境交互需求的提升,机器人也需要使用 3D 视觉系统。作为机器人感知的前沿和核心手段, 3D 视觉通过使用相关仪器来获取物体的图像数据信息,然后再对获取的数据信息进行分析处理,利用三维重建的相关理论重建出真实环境中物体表面的轮廓信息,让机器人感知周围环境中物体的轮廓和距离, 为后续执行指令动作参考使用。

2.2 本体厂视觉方案选择逻辑

从感知输入的第一层看, 当前主流机器人本体厂商在视觉方案选择上已形成清晰分化。一类厂商以纯视觉或视觉优先为核心,通过多目RGB摄像头配合算法能力提升三维理解与场景建模能力,代表性方案包括特斯拉Optimus、傅利叶GR-1等,其特点是硬件结构相对简洁,依赖BEV、Transformer、OCC等算法补齐空间理解能力;另一类厂商则普遍采用视觉 + 深度/激光雷达的融合方案,通过RGB-D(深度相机,能够结合传统 2DRGB相机图像与距离信息的一种深度相机)ToF或3D激光雷达增强对复杂环境的几何感知。此外,也有部分厂商针对ToC或教育场景,采用超广角双目或简化深度方案, 以平衡成本与功能需求。

整体来看,机器人感知层面视觉方案的技术迭代方向主要体现在三方面:一是向算法增强型视觉演进,通过多目协同、时序建模与神经网络提升纯视觉系统的空间理解能力;二是深度传感与视觉的融合形态持续优化,由于人形机器人空间受限、近中距任务为主,双目/iToF 更匹配;激光雷达在机器人中受到体积/功耗/成本约束较多,但在复杂场景仍具价值,叠加成本因素, 因此 RGB-D、ToF 与激光雷达仍将长期存在于主流技术方案中;三是视觉从单纯感知向任务相关感知演进,更加聚焦可操作区域、交互对象与行为结果。

2.3 视觉传感器主要厂商梳理

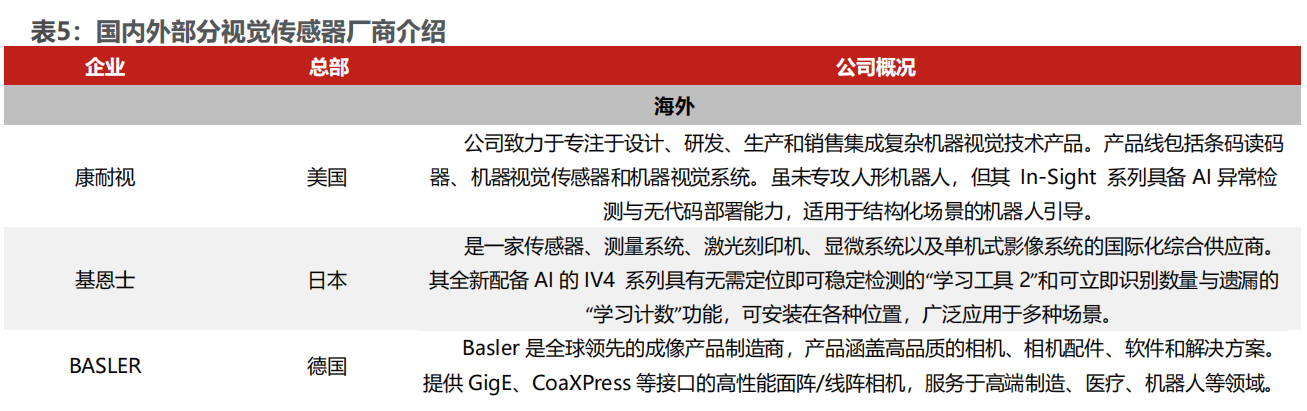

当前,机器人视觉传感器领域已形成国际巨头主导、中国加速崛起、技术路线多元的竞争格局。各厂商的技术方向与市场定位有所不同。国外厂商凭借数十年图像传感器技术积累,主打高可靠性、标准化芯片和成熟 SDK,在全局快门、高动态范围(HDR)、iToF 等底层器件层面保持领先,并依托强大的半导体制造与全球供应链优势,提供高性能、低功耗的通用型视觉模组。而国内厂商则聚焦 3D 视觉与人形机器人应用,提供从传感器到算法、软件平台的全栈解决方案,强调高精度、小体积和快速集成能力,尤其在消费级与工业级服务机器人领域积极布局。

我国机器视觉行业相对于国际机器视觉市场发展较晚, 但在制造业自动化与数字化转型升级的驱动以及在机器视觉技术不断更新迭代的背景下, 中国本土厂商占据的市场份额持续提升,出现了海康机器人、奥比中光、亚博汉、梅卡曼德等一批优秀国产厂商。

2.4 视觉传感器市场空间预测

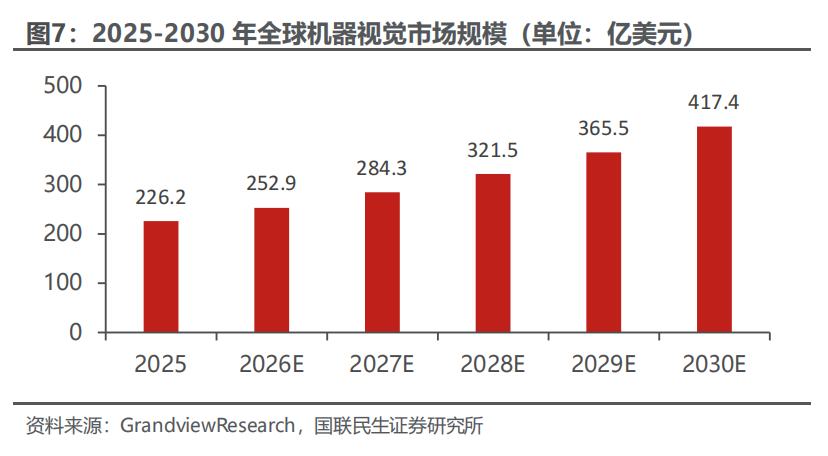

随着机器视觉市场的快速增长,相关技术和应用场景的拓展也为传感器行业带来了新的机遇。根据GGII 预测,2025 年中国机器视觉市场规模有望突破210亿元,同比增速超14%,至2028年我国机器视觉市场规模将超过385亿元,2024-2028 年复合增长率约为 20%。其中 3D 视觉市场规模约为 70 亿元,2024-2028 年复合增长率约为 25.73%。根据 GrandviewResearch 预测,全球机器视觉市场规模2025年将达226亿美元,到2030年将有望增加至417亿美元,2025~2030 年间的年均复合年增长率为 13%。

为了更好地促进行业人士交流,艾邦搭建了机器人产业微信群,欢迎执行器、灵巧手、结构件、摄像头、IMU、传感器、电芯、动力系统、伺服系统、热管理系统、软件算法等零部件、整机组装、设计、设备、原材料企业,以及机器人品牌、终端应用等企业加入,进群交流。

为了更好地促进行业人士交流,艾邦搭建了机器人产业微信群,欢迎执行器、灵巧手、结构件、摄像头、IMU、传感器、电芯、动力系统、伺服系统、热管理系统、软件算法等零部件、整机组装、设计、设备、原材料企业,以及机器人品牌、终端应用等企业加入,进群交流。

为了更好地促进行业人士交流,艾邦搭建了机器人产业微信群,欢迎执行器、灵巧手、结构件、摄像头、IMU、传感器、电芯、动力系统、伺服系统、热管理系统、软件算法等零部件、整机组装、设计、设备、原材料企业,以及机器人品牌、终端应用等企业加入,进群交流。

为了更好地促进行业人士交流,艾邦搭建了机器人产业微信群,欢迎执行器、灵巧手、结构件、摄像头、IMU、传感器、电芯、动力系统、伺服系统、热管理系统、软件算法等零部件、整机组装、设计、设备、原材料企业,以及机器人品牌、终端应用等企业加入,进群交流。

活动推荐1:

活动推荐2:

一、拟邀议题

|

序号 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

医疗康复与养老护理场景的机器人解决方案 |

|

|

|

|

|

|

|

|

|

|

|

电机驱动器与控制模块的供应链整合 |

|

|

高性能执行器用磁性材料与精密机械加工件供应链 |

|

|

高性能 UHMW‑PE 纤维材料在腱驱动系统中的产业化进展 |

|

|

电子皮肤与力觉传感器供应链创新案例 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

议题征集中,创新演讲及赞助请联系Elaine 张 13418617872(同微信)

二、拟邀企业类型:

三、报名方式

报名方式一:

邮箱:ab008@aibang.com

报名方式二:

长按二维码扫码在线登记报名

或者复制网址到浏览器后,微信注册报名

https://www.aibang360.com/m/100296?ref=172672

点击阅读原文,即可报名

2025年,人形机器人产业迎来爆发拐点。特斯拉Optimus量产在即,华为、宇树等企业加速技术突破,行业正从“实验室研发”向“规模化落地”跃迁为打通产业链上下游协作壁垒,艾邦机器人正式组建"人形机器人全产业链交流群",覆盖金属材料、复合材料、传感器、电机、减速器等全硬件环节,助力企业精准对接资源、共享前沿技术!

扫码关注公众号,底部菜单申请进群